In diesem Artikel sammle ich Beispiele, bei denen KI selbstbewusst antwortet, aber tatsächlich versagt. Teilweise handelt es sich um Dinge, die mir passieren, während ich Tools mit künstlicher Intelligenz benutze, teilweise bemerke ich die Schwächen bei Kontrollen, z.B. durch Chathub, eines meiner Lieblingstools zur Arbeit mit KI Chatbots.

10/25 ChatGPT-Ersatzlösung bei Bild-Sperre

Wenn man zu viele Bilder auf einmal erzeugt, hat mich diese Alternative wenig begeistert:

08/25 Videoerzeugung mit Google Veo

Google Veo kann beeindruckende Videos mit gesprochener Sprache erstellen, aber nicht alles klappt gut. Hier ein unterhaltsames Video dazu, warum Kinder nicht zu Fuß in eine Waschanlage gehen sollten:

01/25 Bildformate

Dass Copilot Bilder nur quadratisch ausgibt, ist ja das eine, aber zu behaupten, es wäre ein anderes Format… 😒

01/25: Text ist schwer erkennbar…

11/24: Breit gefächerte Aussagen zu einer Recherche

Für einen Artikel habe ich versucht, den Urheber dieses Modells herauszufinden. Die Modell waren sich nicht einig. Am Besten gefällt mir Google Gemini, das wenigstens einräumt, dass es schwierig ist, eine Aussage zu treffen. Die vermeintlich richtige Antwort Luckner und Nadler war leider nicht dabei.

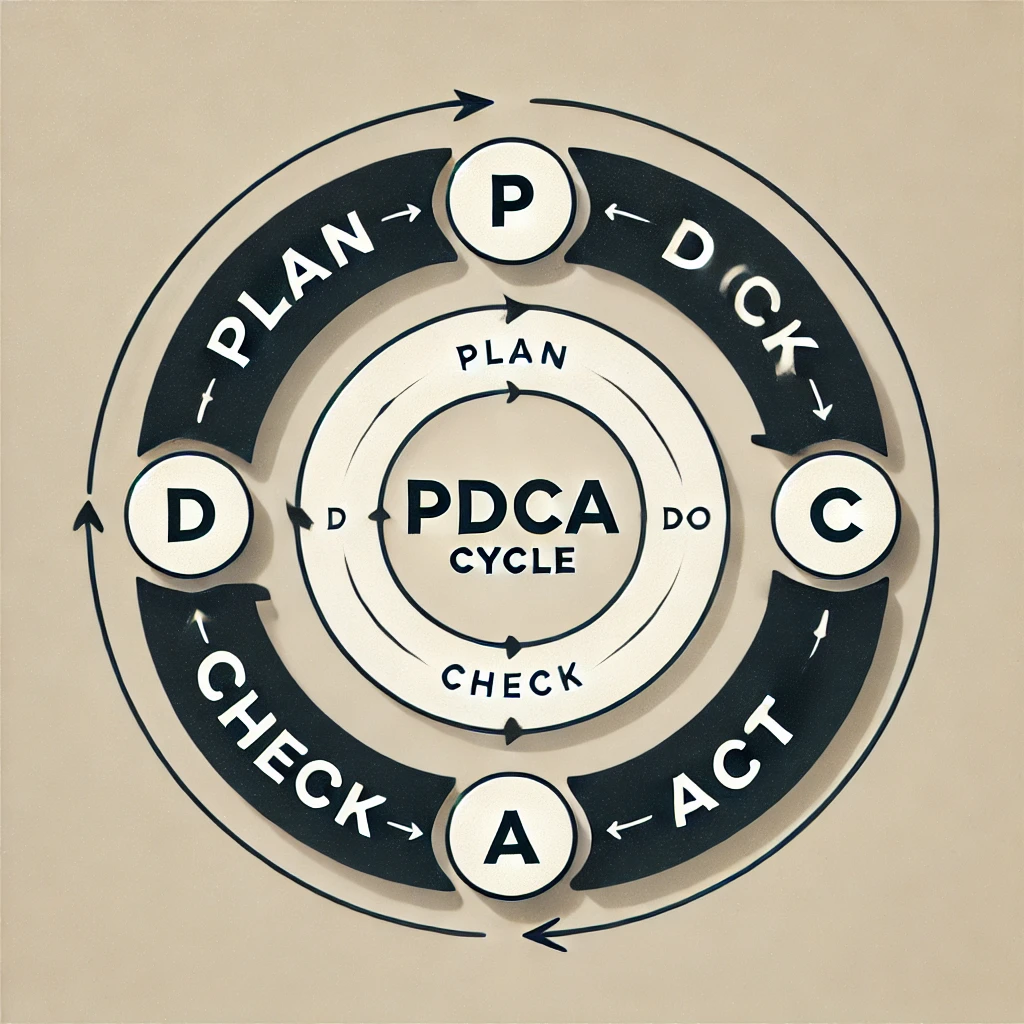

11/24: Schwierig, das Prinzip von Richtung…

Für einen Artikel zur kontinuierlichen Verbesserung habe ich versucht, mir mit ChatGPT einen PDCA-Zyklus darstellen zu lassen. Das hat nicht gut geklappt:

Prompt, 2. Versuch: Let’s try again. The arrows need to all be in clockwise direction. The order of the words needs to be Plan Do Check Act, starting in the top right. Please just use the first letters, PDCA.

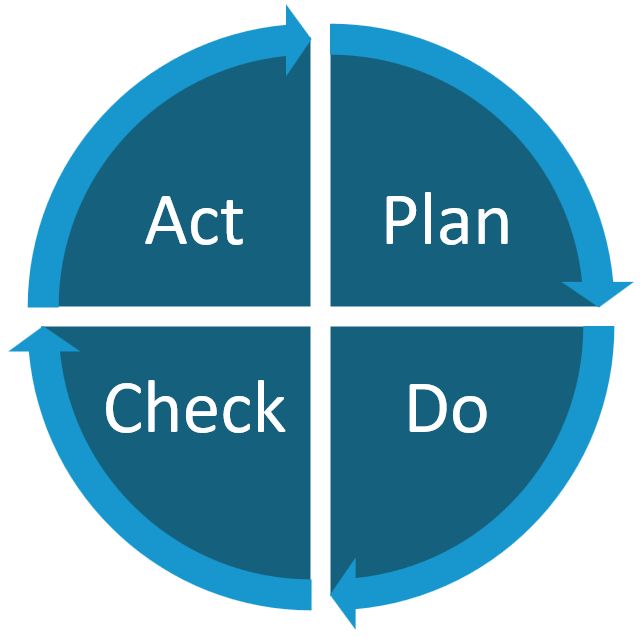

Die richtige Lösung wäre gewesen, habe ich dann schlußendlich in Powerpoint selbst gebaut:

Dieses Beispiel wiegt mich in ziemlicher Sicherheit, was den „Intelligenz“-Teil von Künstlicher Intelligenz angeht. Wenn man bedenkt, dass die Eingabe des Nutzers durch ChatGPT noch einmal verfeinert und optimiert wird, um ein besseres Ergebnis zu erhalten, zeugt dieser Fall von sehr mangelndem Verständnis dessen, was der PDCA-Zyklus bedeutet.

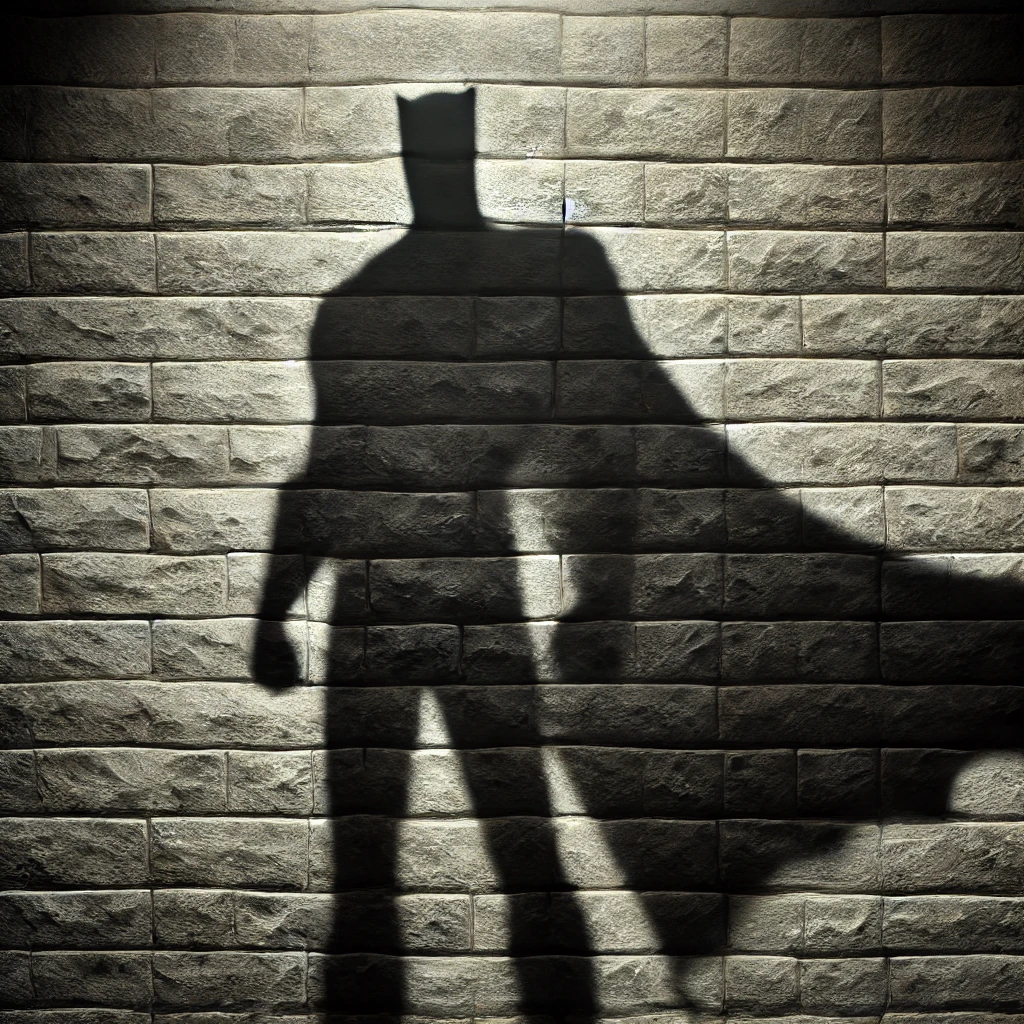

11/24: Was ist jetzt noch einmal ein „Schatten“?

In diesem Fall wollte ich mit ChatGPT ein Bild von Batmans Schatten erstellen, weil ich ein Review des VR-Spiels mit diesem Namen geschrieben habe. Das hat nicht gut geklappt. Das Konzept von Schatten schien ChatGPT überhaupt nicht verstanden zu haben. Der Chat wurde inzwischen gelöscht, vermutlich aus dem gleichen Grund, weshalb ich jetzt einen freundlichen Hinweis bekomme, dass Batman ein urheberrechtlich geschützer Charakter ist. Dementsprechend ist es vielleicht auch schlauer, das alte schattenfreie Ergebnis hier nicht zu zeigen. Auf jeden Fall war es Batman in diversen Posen – kein einziges Mal sein Schatten, bei mehreren Versuchen. Mit der Bitte nach „nur dem Schatten“ des „caped crusader“ hat es dann gerade aber geklappt:

Schreibe einen Kommentar